导入 MP3、M4A、WAV、AAC、FLAC 音频文件和 MP4、MOV、M4V 视频文件。iOS 使用 WhisperKit、Android 使用 whisper.cpp,完全在设备上转录。AI 自动清理填充词和重复停顿,生成更干净的文本。点击任意回答即可跳转到时间戳标记的片段。

导入文档,用自然语言提问,获取AI驱动的回答 — 所有处理均在您的设备上完成。

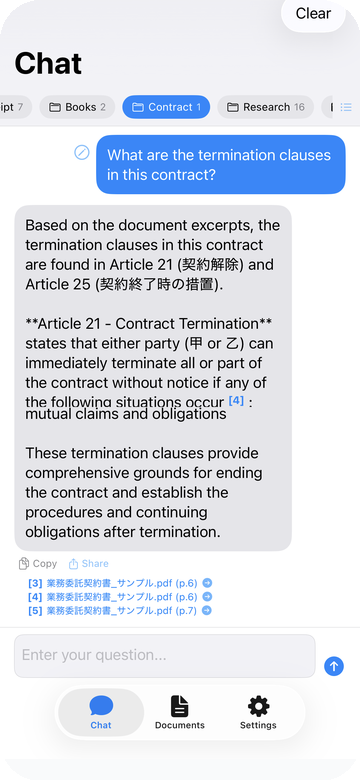

"终止条款是什么?" "总结第三章。" 只需用自然语言输入问题,LocalRAG! 就会搜索所有文档,找到最相关的段落。无需逐个打开文件——AI帮你全部读完。

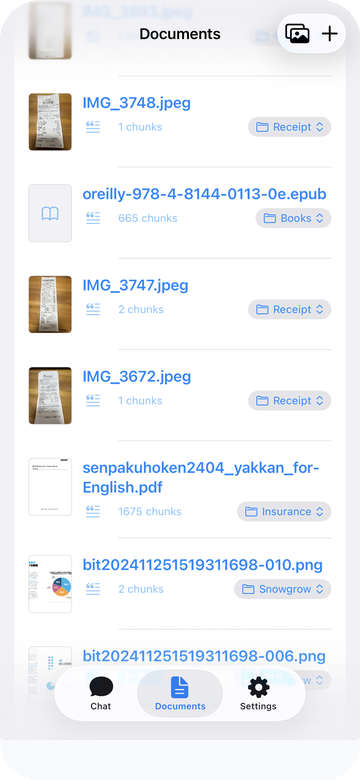

PDF、EPUB、Word、Excel、PowerPoint、图片、扫描文档——23种文件格式汇聚在一个集合中,一次性搜索全部内容。白板照片和扫描PDF会自动通过OCR提取文字,支持AI问答。

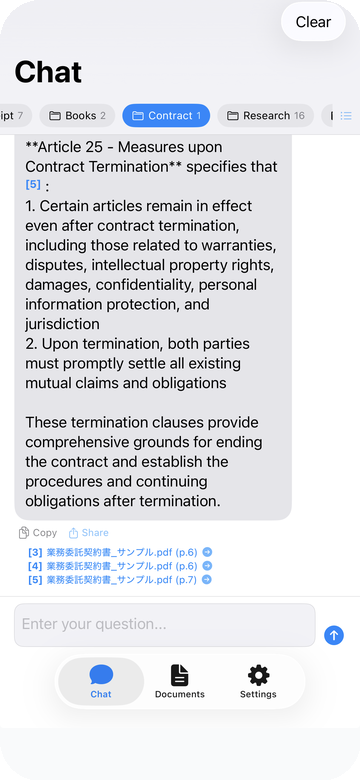

每个AI回答都包含页面级来源引用,如"Service-Agreement.pdf (p.12)"——让你始终清楚答案来自哪个文档的哪一页。不要盲目信任AI——请对照原文验证。

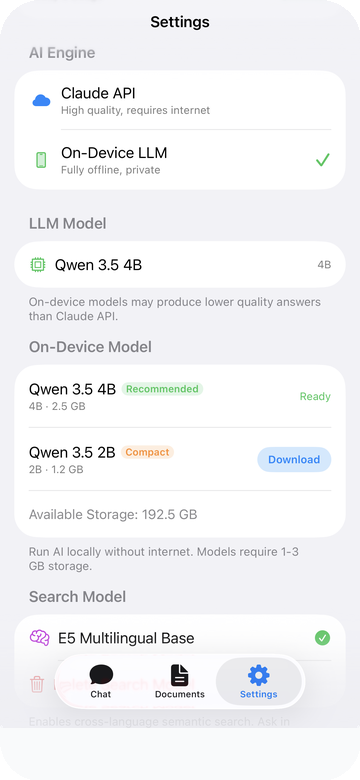

内置本地LLM(Qwen3 4B)完全在设备上运行。无需网络连接,不向任何服务器发送数据。放心地用AI处理机密文档和个人文件。需要更高精度?随时切换到Claude API。

几秒钟内从长篇报告、手册和研究论文中提取关键要点。

即时查找终止条款、竞业禁止、付款条件和风险。

提取研究成果、理解研究方法,与学术论文对话。

少数支持原生EPUB的AI工具之一。总结章节并提出问题。

导入白板照片、收据或文件照片。设备端OCR提取文字,即可用AI进行问答。

导入会议录音。问"预算决定是什么?"。获得带时间戳的答案,点击跳转。

导入讲座录像 (MP4, MOV)。设备端转录提取内容。让 AI 解释概念,跨多个视频查找主题。

记者、研究人员、律师可完全在设备上转录敏感采访。无上传,完整消息源保密。

PDF、Word、EPUB — 无论什么格式,只需添加到合集中。AI 一次搜索所有文档。

会议PDF、Word会议纪要、文本备忘录 — 格式无所谓。添加到合集后问「那个问题最终决定了什么?」不用再逐个打开文件了。

把未读的PDF和EPUB一起导入。不用翻一页,直接问「这本书的核心观点是什么?」或「解释一下第三章的方法」。AI替你读完每一页。

ISO标准PDF、RFC文本文件、公司内部Word规范 — 全部加载到一个合集中。问「认证要求有哪些?」LocalRAG 会在所有文档中找到相关章节。

保险条款、用户手册、合同、食谱。什么都可以添加到合集中。你可能忘了里面有什么,但 LocalRAG 不会忘。需要时直接问 — 它会告诉你哪份文档有答案。

看看 LocalRAG! 如何将您的文档变成智能对话。

两种与文档对话的方式。根据需求选择。

| 设备端AI | Claude API | |

|---|---|---|

| 需要网络 | 不需要 — 完全离线 | 需要 |

| 发送到服务器的数据 | 无 — 零云端 | 仅问题+相关摘录 |

| 回答质量 | 良好(4B模型) | 优秀(Opus / Sonnet / Haiku) |

| 响应速度 | 约10秒至数分钟 | 约3秒 |

| 模型下载 | 约3GB(仅首次) | 不需要 |

| 支持平台 | iOS & Android(测试版) | iOS和Android |

两种模式下,文档处理(文本提取、索引构建、搜索)均在设备上完成。设备端AI更进一步,在本地生成回答,任何数据都不会离开您的设备。

「我导入了12本教科书的PDF,问了一句'解释TCP和UDP的区别',就得到了带页码的清晰回答——再也不用翻3,000页了。」

「我把30篇论文放进一个集合,问'哪些研究使用了基于Transformer的医学影像模型?'几秒钟就找到了8篇相关论文。」

「我审查一份120页的保密协议,问了句'有没有竞业禁止条款?'它找到了两处——在第34页和第78页——手动审查很可能会遗漏。」

「团队的SOP、合规文件和会议记录全部放在一个集合里。新员工只需问'供应商合同的审批流程是什么?'就能立即得到答案。」

尊重隐私的强大文档 AI。

文档(PDF、EPUB、DOCX、XLSX、PPTX、TXT、MD、CSV、RTF、HTML)、图片(JPG、PNG、HEIC、WebP)、音频(MP3、M4A、WAV、AAC、FLAC)、视频(MP4、MOV、M4V)— 还支持扫描件和加密PDF。

用日常语言向文档提问,获得带出处引用的回答。

AI回答中显示[1][2]来源引用,点击即可跳转。直接跳转到引用页面,精确段落以黄色高亮标记。

所有文档处理均在设备本地完成。您的文件绝不会离开您的设备。

Okapi BM25搜索配合设备端嵌入模型(E5 Multilingual),实现跨语言语义检索。用日语提问,在英语文档中找到答案。

导入白板照片、收据或扫描文件。设备端OCR提取文字,即可进行AI问答,并且可以在索引前编辑提取的文本。

将文档整理到最多3层嵌套文件夹中。父级范围包含所有子文档,便于精准问答。

内置本地LLM完全在设备上运行——无需网络、无API调用、零数据发送。真正的零云端文档AI。

使用离线的设备端AI,或选择Claude Sonnet 4.5 / Haiku 4.5 / Opus 4获取更高精度。

三步开启文档对话。

从文件管理器或其他应用添加文档,支持 9 种格式。

LocalRAG! 自动提取文本并构建搜索索引 — 全部在设备本地完成。

随意提问,AI 将结合出处引用为您作答。

您常用的文档类型,一个应用全部搞定。

文档处理——文本提取、分块和搜索索引构建——完全在您的设备上进行。您的文件不会被上传到任何地方。使用离线AI模式时,回答也完全在设备上生成,没有任何数据发送到外部。使用Claude模式时,只有您的问题和最相关的 10 个文本片段(每个约 500 字符)会发送到 Claude API 进行 AI 推理。完整文档永远不会被传输。

云端服务需要您将整个文档上传到其服务器。LocalRAG! 将文件保留在您的设备上,提问时只发送小部分相关摘录。因此它适合处理合同、医疗记录或机密研究资料等敏感文档。此外,内置的设备端 AI(iOS 和 Android(测试版))支持完全离线运行,任何数据都不会离开您的设备。

不会。Anthropic 的 API 使用政策明确规定,API 的输入和输出不会用于模型训练。这与免费的 Claude 消费者产品不同。您的文档摘录在处理后即被丢弃。

可以。免费计划包含每天 5 次 Claude Haiku 提问,同时还可以无限制使用设备端AI(离线模式)——完全不需要网络。您还可以使用自己的 Anthropic API 密钥(BYOK),无需订阅即可无限制访问所有模型——您只需直接向 Anthropic 支付 API 使用费。

LocalRAG!内置了一个在设备上运行的语言模型。下载模型(约3GB)后,即可在完全无网络的情况下对文档提问。回答在设备上生成,没有任何数据发送到服务器。所有计划均可使用。支持iOS和Android(测试版)。

LocalRAG! 支持 23 种格式,分四类:10 种文档格式(PDF、EPUB、DOCX、XLSX、PPTX、TXT、Markdown、CSV、RTF、HTML)、4 种图片格式(JPG、PNG、HEIC、WebP)通过设备端 OCR 处理、5 种音频格式(MP3、M4A、WAV、AAC、FLAC)和 3 种视频格式(MP4、MOV、M4V)通过 WhisperKit(iOS)和 whisper.cpp(Android)在设备上转录。还支持扫描版和防复制的 PDF。