LocalRAG! est-il vraiment local ? Quelles données sont envoyées dans le cloud ?

Le traitement des documents — extraction de texte, découpage et indexation — se fait entièrement sur votre appareil. Vos fichiers ne sont jamais téléchargés. En mode IA hors ligne (LLM local), tout reste sur votre appareil — aucune donnée n’est envoyée. En mode en ligne, seuls votre question et les 10 extraits de texte les plus pertinents (environ 500 caractères chacun) sont envoyés à l’API Claude. Le document complet n’est jamais transmis.

En quoi est-ce différent de ChatPDF, PDF.ai ou d’autres outils cloud ?

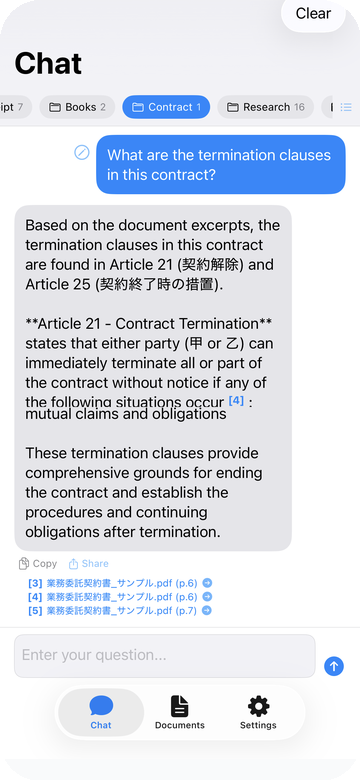

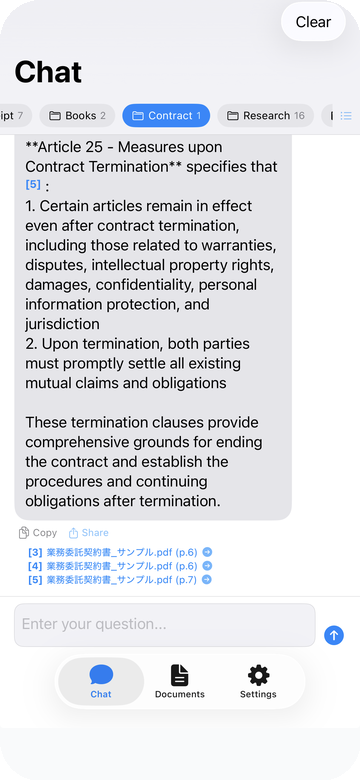

Les services cloud exigent de télécharger l’intégralité de votre document sur leurs serveurs. LocalRAG! conserve vos fichiers sur votre appareil et n’envoie que de petits extraits pertinents lorsque vous posez une question. Il convient donc aux documents sensibles comme les contrats, dossiers médicaux ou recherches confidentielles. De plus, avec l’IA embarquée (iOS et Android (bêta)), vous pouvez fonctionner entièrement hors ligne — aucune donnée ne quitte votre appareil.

Anthropic utilise-t-il mes données pour l’entraînement de l’IA ?

Non. La politique d’utilisation de l’API d’Anthropic stipule explicitement que les entrées et sorties de l’API ne sont pas utilisées pour l’entraînement des modèles. Cela diffère du produit gratuit Claude grand public. Vos extraits de documents sont traités puis supprimés.

Puis-je utiliser LocalRAG! sans abonnement ?

Oui. Le plan gratuit comprend 5 questions par jour avec Claude Haiku, ainsi que l’IA embarquée (LLM local) qui fonctionne hors ligne sans aucune limite. Vous pouvez également utiliser votre propre clé API Anthropic (BYOK) pour un accès illimité à tous les modèles sans frais d’abonnement — vous ne payez que l’utilisation de l’API directement à Anthropic.

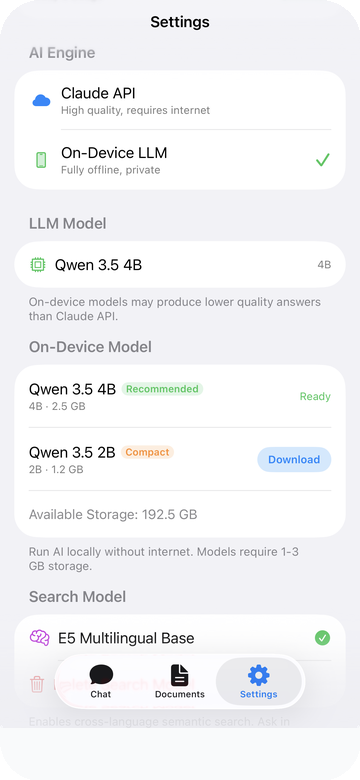

Comment fonctionne l’IA hors ligne (LLM local) ?

LocalRAG! intègre un modèle de langage qui fonctionne entièrement sur votre appareil. Après le téléchargement du modèle (~3 Go), vous pouvez interroger vos documents sans connexion internet. Les réponses sont générées sur l’appareil — aucune donnée n’est envoyée. Disponible sur tous les plans. Disponible sur iOS et Android (bêta).

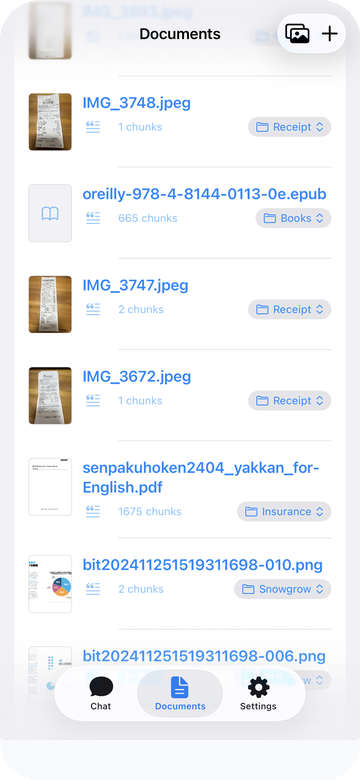

Quels formats de documents sont pris en charge ?

LocalRAG! prend en charge 23 formats répartis en quatre catégories : 10 formats de documents (PDF, EPUB, DOCX, XLSX, PPTX, TXT, Markdown, CSV, RTF, HTML), 4 formats d'images (JPG, PNG, HEIC, WebP) traités par OCR embarqué, 5 formats audio (MP3, M4A, WAV, AAC, FLAC) et 3 formats vidéo (MP4, MOV, M4V) transcrits sur l'appareil avec WhisperKit (iOS) et whisper.cpp (Android). Les PDF numérisés et protégés contre la copie sont également pris en charge.

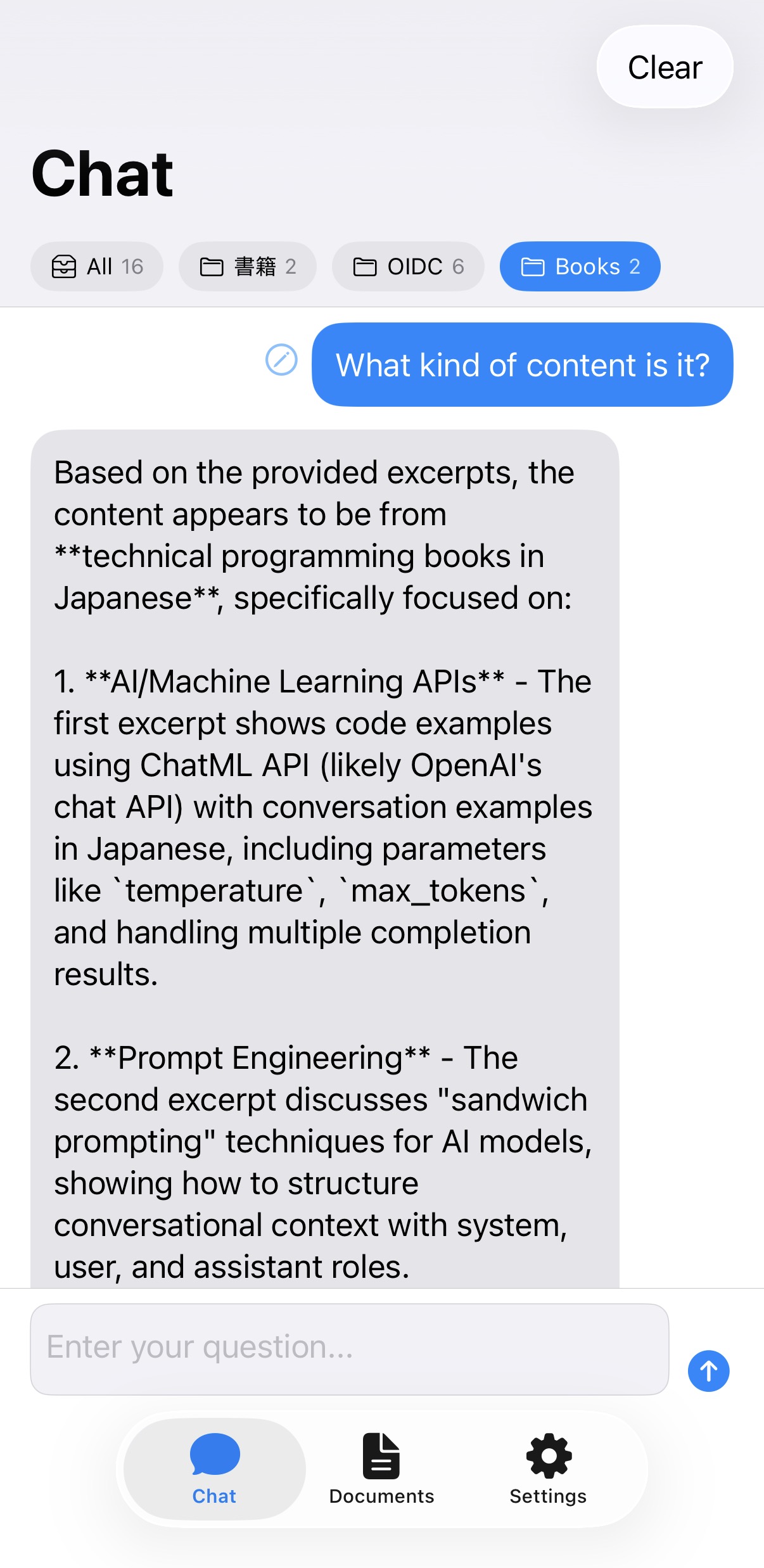

Chat IA avec vos documents — PDF, audio, vidéo et plus

Chat IA avec vos documents — PDF, audio, vidéo et plus