¿LocalRAG! es realmente local? ¿Qué datos se envían a la nube?

El procesamiento de documentos — extracción de texto, fragmentación e indexación — se realiza completamente en tu dispositivo. Tus archivos nunca se suben a ningún lugar. Con el modo IA sin conexión (LLM local), incluso las respuestas se generan en el dispositivo — ningún dato sale de tu dispositivo. Cuando usas los modelos de Claude en línea, solo tu pregunta y los 10 fragmentos de texto más relevantes (de unos 500 caracteres cada uno) se envían a la API de Claude. El documento completo nunca se transmite.

¿En qué se diferencia de ChatPDF, PDF.ai u otras herramientas en la nube?

Los servicios en la nube requieren subir todo el documento a sus servidores. LocalRAG! mantiene tus archivos en tu dispositivo y solo envía pequeños extractos relevantes cuando haces una pregunta. Esto lo hace ideal para documentos sensibles como contratos, historiales médicos o investigaciones confidenciales. Además, con la IA integrada en el dispositivo (iOS y Android (beta)), puedes funcionar completamente sin conexión — ningún dato sale de tu dispositivo.

¿Anthropic usa mis datos para entrenar la IA?

No. La política de uso de la API de Anthropic establece explícitamente que las entradas y salidas de la API no se utilizan para el entrenamiento de modelos. Esto es diferente del producto gratuito Claude para consumidores. Los extractos de tus documentos se procesan y se descartan.

¿Puedo usar LocalRAG! sin suscripción?

Sí. El plan gratuito incluye 5 preguntas al día con Claude Haiku, además del modo IA en dispositivo que funciona completamente sin conexión y sin límites. También puedes usar tu propia clave API de Anthropic (BYOK) para acceso ilimitado a todos los modelos sin costo de suscripción — solo pagas el uso de la API directamente a Anthropic.

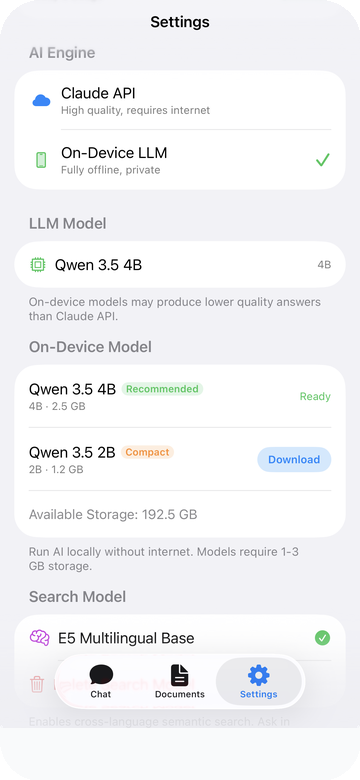

¿Cómo funciona la IA sin conexión (LLM local)?

LocalRAG! incluye un modelo de lenguaje integrado que funciona completamente en tu dispositivo. Después de descargar el modelo (~3 GB), puedes hacer preguntas sobre tus documentos sin conexión a internet. Las respuestas se generan en el dispositivo — ningún dato se envía a servidores. Disponible en todos los planes. Disponible en iOS y Android (beta).

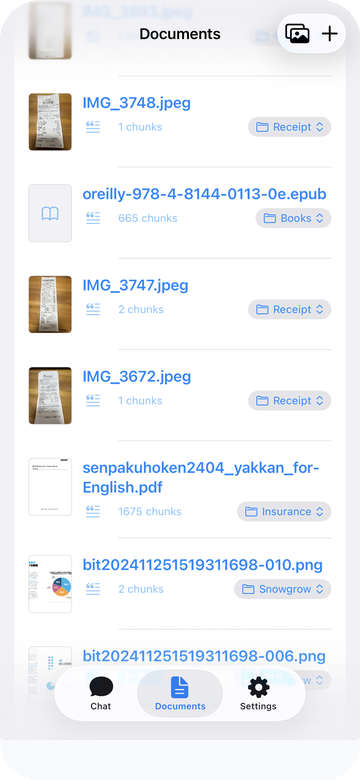

¿Qué formatos de documentos se admiten?

LocalRAG! admite 23 formatos en cuatro categorías: 10 formatos de documentos (PDF, EPUB, DOCX, XLSX, PPTX, TXT, Markdown, CSV, RTF, HTML), 4 formatos de imagen (JPG, PNG, HEIC, WebP) procesados con OCR en el dispositivo, 5 formatos de audio (MP3, M4A, WAV, AAC, FLAC) y 3 formatos de vídeo (MP4, MOV, M4V) transcritos en el dispositivo con WhisperKit (iOS) y whisper.cpp (Android). Los PDF escaneados y protegidos contra copia también se admiten.

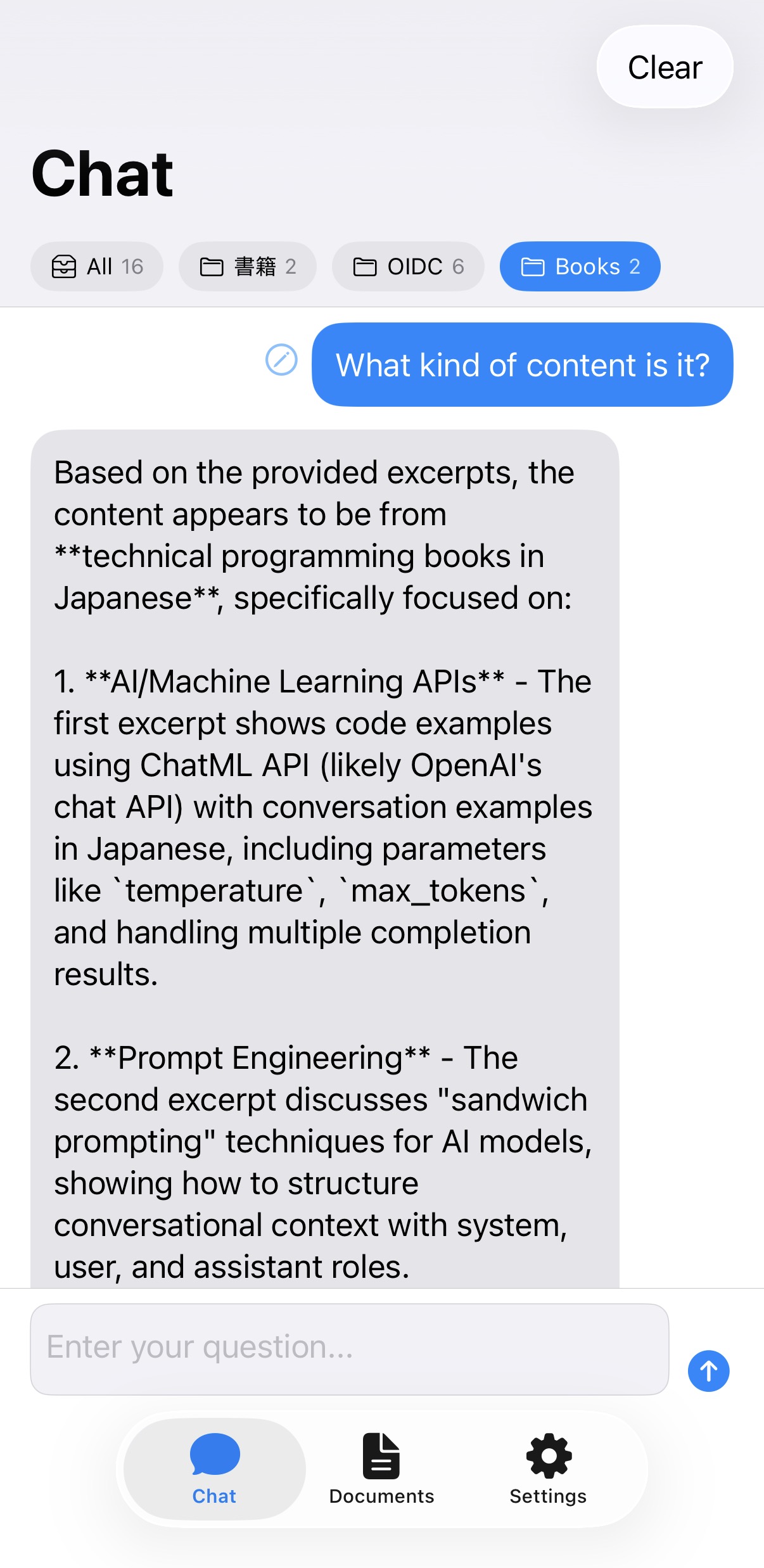

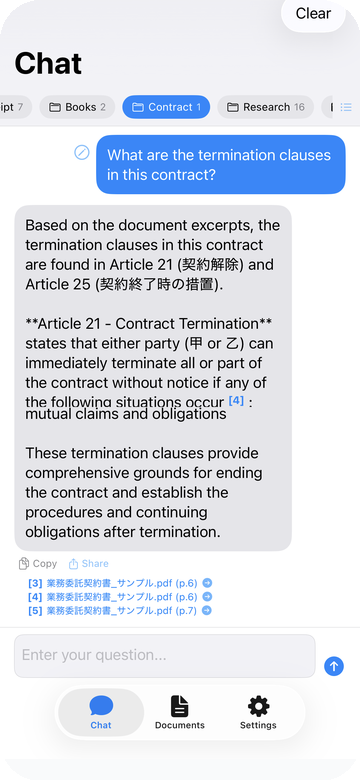

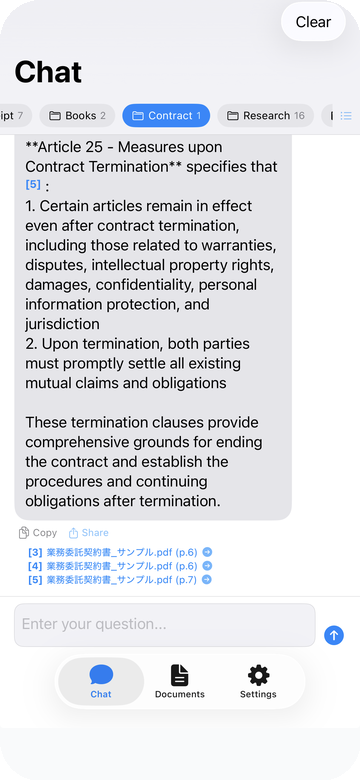

Chat IA con documentos — PDF, audio, vídeo y más

Chat IA con documentos — PDF, audio, vídeo y más